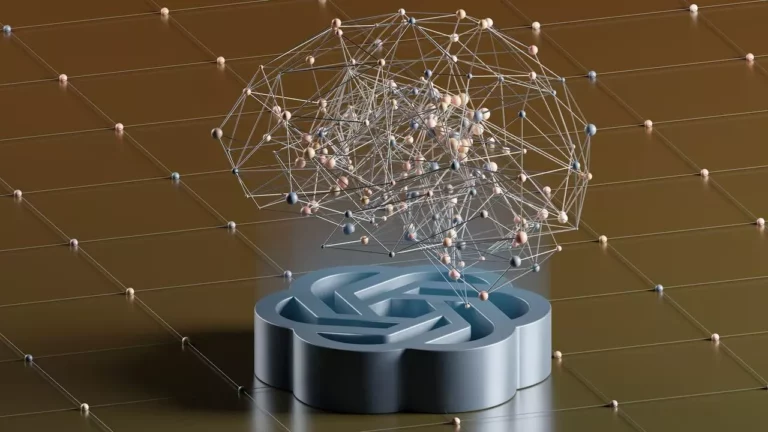

Intelligenza Artificiale e il Controllo delle Armi Nucleari: La Nuova Frontiera della Tecnologia Militare

L’Intelligenza artificiale prenderà il controllo delle armi nucleari? L’IA rappresenta una delle più grandi innovazioni tecnologiche del nostro tempo. La sua applicazione si estende a numerosi settori, tra cui il militare, dove si sta discutendo dell’impiego di questa tecnologia nel controllo delle armi nucleari. Gli Stati Uniti, in particolare, stanno affrontando questa sfida attraverso la definizione di nuove politiche e linee guida.

Il Nuovo Piano per lo Sviluppo Responsabile dell’Intelligenza Artificiale Militare

Ad aprile, il Dipartimento di Stato degli Stati Uniti ha presentato un piano che si propone di guidare lo sviluppo, il collaudo e la verifica dei sistemi militari basati sull’intelligenza artificiale, comprese le armi. Questo piano, noto come “Dichiarazione politica sull’uso militare responsabile dell’intelligenza artificiale e dell’autonomia”, mira a stabilire standard globali per lo sviluppo responsabile dei sistemi AI.

Le nuove linee guida stabiliscono che l’intelligenza artificiale militare deve essere sviluppata in conformità con le leggi internazionali e che i paesi devono essere trasparenti riguardo ai principi alla base della propria tecnologia. Inoltre, si sottolinea l’importanza di adottare standard elevati per la verifica delle prestazioni dei sistemi di intelligenza artificiale. Un aspetto fondamentale della dichiarazione è l’affermazione che le decisioni sull’uso delle armi nucleari dovrebbero essere esclusive degli esseri umani.

La Tensione tra Stop ed Espansione

Nonostante gli sforzi per regolamentare l’impiego dell’intelligenza artificiale nel contesto militare, non è stato ancora raggiunto un divieto internazionale sulle armi autonome. Organizzazioni come la Croce Rossa Internazionale e Stop Killer Robots stanno spingendo per un accordo sotto l’egida delle Nazioni Unite, ma alcune grandi potenze, tra cui Stati Uniti, Russia, Israele, Corea del Sud e Australia, non sembrano disposte ad aderire a un impegno di questo tipo.

Uno dei motivi di questa resistenza è la convinzione che l’aumento dell’uso dell’intelligenza artificiale all’interno delle forze armate sia vitale e inevitabile. Secondo alcuni esperti del Ministero della Difesa statunitense, un divieto rallenterebbe i progressi degli Stati Uniti, mettendo il paese in svantaggio rispetto a nazioni come la Cina e la Russia. Tuttavia, è importante considerare i rischi associati all’impiego dell’intelligenza artificiale nel contesto militare.

I Rischi dell’Impiego dell’Intelligenza Artificiale in Ambito Militare

L’intelligenza artificiale, se utilizzata in modo inappropriato o senza adeguati controlli, potrebbe rappresentare un grave rischio per la sicurezza internazionale. Uno dei principali timori riguarda l’aumento della velocità di processo decisionale. Ad esempio, nel caso di un possibile attacco missilistico, una risposta automatica basata sull’intelligenza artificiale potrebbe essere più veloce di quella umana. Tuttavia, cosa succederebbe se si trattasse di un falso segnale? La difficile distinzione tra una minaccia reale e un errore potrebbe avere conseguenze catastrofiche.

Il Pentagono e il Consiglio di Sicurezza Nazionale degli Stati Uniti stanno attualmente discutendo il tema del controllo degli armamenti tramite intelligenza artificiale. Mentre alcuni sostengono che fermare lo sviluppo dell’intelligenza artificiale non serva a nulla, poiché altri paesi non si fermeranno, è fondamentale considerare i possibili utilizzi delle IA in ambito militare.

Possibili Utilizzi dell’Intelligenza Artificiale nel Controllo delle Armi Nucleari

L’utilizzo dell’intelligenza artificiale nel controllo delle armi nucleari è un argomento di grande interesse e preoccupazione. Durante gli incontri del Pentagono e del Consiglio di Sicurezza Nazionale, l’intelligenza artificiale è stata menzionata come una potenziale nuova tecnologia per ribaltare le guerre, compreso il processo decisionale sull’impiego di armi nucleari.

Secondo il portavoce del settore informatico del Pentagono, fermare lo sviluppo dell’intelligenza artificiale non risolverebbe il problema, poiché altri paesi continueranno a progredire in questo ambito. Tuttavia, è fondamentale considerare i rischi associati all’impiego di questa tecnologia nel controllo delle armi nucleari.

L’Importanza di un Controllo Adeguato

La velocità e l’efficacia dell’intelligenza artificiale potrebbero rappresentare un vantaggio strategico nel contesto di un conflitto. Tuttavia, è fondamentale garantire un controllo adeguato e una supervisione umana nel processo decisionale sull’uso delle armi nucleari.

L’esempio di un falso segnale è significativo, poiché evidenzia la difficoltà di distinguere tra una minaccia reale e un errore. Affidare completamente alle macchine la responsabilità di prendere decisioni così cruciali potrebbe condurre a conseguenze catastrofiche.

La Regolamentazione dell’Intelligenza Artificiale Militare

La comunità internazionale si trova di fronte a una sfida cruciale: regolamentare l’impiego dell’intelligenza artificiale nel contesto militare. Mentre alcuni sostengono che un divieto totale sarebbe la soluzione migliore, altri ritengono che sia possibile trovare un equilibrio tra lo sviluppo tecnologico e la sicurezza internazionale.

Le linee guida proposte dal Dipartimento di Stato degli Stati Uniti rappresentano un passo importante verso lo sviluppo responsabile dell’intelligenza artificiale militare. Tuttavia, è necessario coinvolgere le nazioni alleate per creare un vero e proprio standard globale che garantisca la conformità alle leggi internazionali e la supervisione umana nelle decisioni sull’uso delle armi nucleari.

Controllo delle armi nucleari

L’impiego dell’intelligenza artificiale nel controllo delle armi nucleari rappresenta una nuova frontiera tecnologica che richiede una regolamentazione adeguata e una supervisione umana. Mentre gli Stati Uniti cercano di guidare lo sviluppo responsabile dell’intelligenza artificiale militare, è fondamentale coinvolgere le nazioni alleate per creare standard globali che garantiscano la sicurezza internazionale.

La tensione tra lo stop e l’espansione dell’uso dell’intelligenza artificiale nel contesto militare evidenzia l’importanza di un dibattito approfondito e di una regolamentazione condivisa. Solo attraverso un approccio collaborativo sarà possibile affrontare le sfide e sfruttare appieno il potenziale dell’intelligenza artificiale nel contesto della sicurezza internazionale.